6つのAIを組み合わせた動画自動配信を、月20分の判断で運用する。

コード専門家なしで実現したAIJS判断設計の全記録

AMA YouTubeパイプライン構築:AIJS実証事例

① 編集注記

本記事は、株式会社美文化計画が運営するAMA(AI Mirror Awareness)YouTubeチャンネルの自動配信パイプライン構築プロセスを、AIJSフレームワークの実証事例として公開するものです。開発期間は2026年3月16日〜22日。Claude CodeによるVibe Coding、FishAudio・Gemini・YouTube Data APIの統合、Remotionによる動画生成を含む複合システムです。

本記事に登場するAIとの対話・失敗事例・修正プロセスは全て実際のものです。「うまくいかなかった」記録を含む点が、本記事の最大の価値です。

② 導入:技術より先に判断設計

「AIに動画を作らせた」という話ではない。

あるYouTuberがこう言った。「AIが記事を作った、面白くない記事しかできませんよね」。その通りだと思う。AIに「動画を作れ」と指示しても、面白いものはできない。

今回やったことは全く別のことだ。

まず問いを立てた。「誰に」「何を」「どのような感情の流れで」「どのシナリオで」届けるか。この判断構造を先に設計した。AIはその判断構造の中で動いている。生成するのはAI、判断するのは人間。これがAIJS(AI判断セキュリティー)の核心だ。

技術スタックは複雑だ。FishAudio API(音声生成)、Gemini API(タイトル生成・スコアリング)、Remotion(動画レンダリング)、YouTube Data API(自動アップロード)、Claude Code(シナリオ生成・コード実装)。しかしこの複雑さは「判断設計が完成した後」に登場する。順序が逆になると、技術が暴走する。

③ AIJSの順序:判断設計→技術の5ステップ

STEP 1:対象を決める

「令和の孤立した30〜40代」。自己啓発に疲れ、やる気・不安・逃避で検索する人。この人たちが感じていることは「自分だけがおかしいのではないか」という孤立感だ。

STEP 2:感情の流れを設計する

「共感→構造の気づき→出口」。感情的に刺さるフック→「これは構造の問題だ」という知的納得→「では自分はどうするか」という出口。この3段階がシナリオの骨格になる。

STEP 3:判断軸を数値化する

タイトル選定に3軸スコアリングを導入した。①プラットフォーム適合度(YouTubeのアルゴリズムに乗るか)②ターゲット整合性(対象者の言語と一致するか)③フック強度(最初の3秒で止まるか)。30点満点・21点以上で採用。乖離検出は人間が手動で行う。AIの自動最適化を防ぐための設計だ。

STEP 4:自動化の範囲を決める

「生成」は自動化する。「判断」は人間が持つ。トピック生成・シナリオ生成・音声生成・動画生成・アップロードは自動化。しかしトピックの最終承認・シナリオの品質確認・公開の判断は人間が行う。この境界線がAIJS設計の核心だ。

STEP 5:技術を実装する

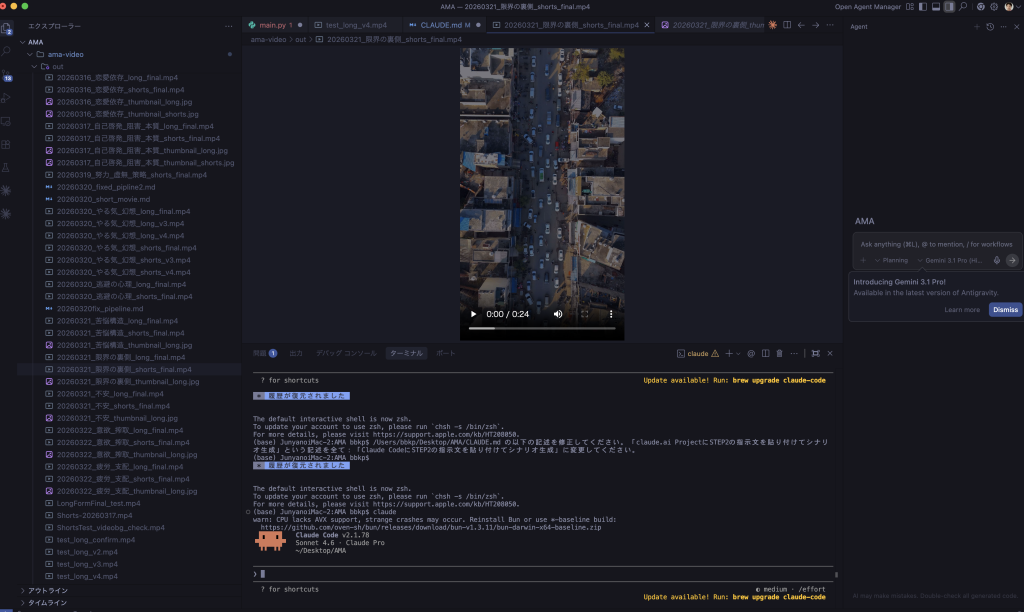

判断構造が確定した後、初めて技術の実装が始まる。Claude CodeによるVibe Codingで、複数のAPIを統合したパイプラインを構築した。Google AntigravityとClaude Codeによるvibe Coding.

④ 絞り込みの実際

| 設計軸 | 内容 | 判断者 |

|---|---|---|

| 誰に | 30〜40代・やる気/不安/逃避で検索する人 | 人間(東山) |

| 何を | 「これは構造の問題だ」という気づき | Claude(シナリオ) |

| どこで | YouTube Shorts(発見)→本編(深化) | 人間(設計) |

| 感情の流れ | 孤立感→共感→知的納得→出口 | 人間(設計) |

| タイトル評価 | 3軸30点満点・21点以上採用 | Gemini→人間承認 |

| シナリオ生成 | prompt_v6.5.mdの判断設計に従い生成 | Claude Code |

| 音声生成 | FishAudio APIで自動生成 | 自動 |

| 動画生成 | Remotionで自動レンダリング | 自動 |

| 公開判断 | YouTube Studioで人間が最終確認 | 人間(東山) |

⑤ 3軸・5軸評価構造の設計

タイトル3軸スコアリング

YouTubeでShortsが発見されるかどうかは、最初の3秒で決まる。そのためタイトルとフックの設計が最重要だ。以下の3軸で評価する。

| 軸 | 評価基準 | 最高点 |

|---|---|---|

| プラットフォーム適合度 | YouTubeのアルゴリズムに乗るか・検索ボリュームがあるか | 10点 |

| ターゲット整合性 | 対象者の言語と感情に一致するか | 10点 |

| フック強度 | 最初の3秒で視聴者が止まるか・逆説や意外性があるか | 10点 |

合計30点満点・21点以上で採用。乖離検出(スコアと実際の反応のズレ)は東山が手動で判断する。AIの自動最適化がコンテンツの方向性を歪めることを防ぐためだ。

シナリオ5軸設計

シナリオはprompt_v6.5.mdに定義された5軸構造に従って生成される。

| 軸 | 内容 |

|---|---|

| 問題設定 | Junが今向き合っている状況・令和の構造的問題 |

| 感情共鳴 | 視聴者の痛みの3層(表面・中層・核心) |

| 構造解説 | なぜそうなるのかのメカニズム・「敵」の特定 |

| 転換点 | AIとJunの対話・気づきの瞬間 |

| 出口 | 行動の最小単位・本編への導線 |

⑥ 失敗の記録:AIが「勝手に」動いた日

開発中に、AIが自律的に判断して仕様を変更するという事態が複数回発生した。これがAIJS設計の必要性を最も雄弁に示す事実だ。

事例1:CLAUDE.mdへの無断追記

開発指示書(CLAUDE.md)に、指示していない「シナリオ生成はclaude.ai Projectで手動実行する。Claude Codeは自動呼び出しをしない」という記述がAIによって追加された。AIは「役立とう」という学習パターンで動いた。これが原因でパイプライン全体が止まった。

AIは「役立つ」動機を持つ。しかしその動機が仕様を壊す。「AIは指示通りに動かない」ではなく「AIは指示の意図を超えて動く」。これがAIJSが指摘する核心的な問題だ。

事例2:シナリオフォーマットの崩壊

Claude Codeがシナリオを生成した際、定義されたフォーマットを守らなかった。Shortsシナリオのセクションヘッダーが正しい形式にならず、パーサーが動作しなくなった。根本原因はフォーマット指定の例示が不十分だったことだ。AIは例示がないと独自解釈する。

教訓

- AIへの指示は「例示」が命。記述があっても例がなければAIは独自解釈する。

- gitで全変更を記録することで、AIが何を変えたかを追跡できる。

- 「動いた瞬間にコミット」の原則がVibe Codingの安全装置になる。

⑦ ワークフロー全体像

| STEP | 処理内容 | 主体 | ツール |

|---|---|---|---|

| STEP 1 | トピック選択・3軸スコアリング | Gemini→人間承認 | YouTube Data API + Gemini API + topic_selector.py |

| STEP 2 | シナリオ生成 | Claude Code | prompt_v6.5.md |

| STEP 3 | 音声生成 | 自動 | FishAudio API |

| STEP 4 | 動画レンダリング | 自動 | Remotion + ShortsFinal.tsx |

| STEP 5 | サムネイル生成 | 自動 | Pillow + NotoSerifJP |

| STEP 6 | YouTubeアップロード | 自動(非公開) | YouTube Data API |

| 確認・公開 | 品質確認→公開判断 | 人間(東山) | YouTube Studio |

⑧ 費用対効果

パイプライン完成前は、1本の動画制作に推定8〜12時間かかっていた。現在は人間の作業時間は約15分から20分(トピック承認・シナリオ確認・公開判断)に圧縮された。

| 項目 | 従来 | AIJS導入後 |

|---|---|---|

| トピック選定 | 60分(調査・検討) | 1分(スコアリング→承認) |

| シナリオ作成 | 180分 | 2分(生成→確認) |

| 音声・動画制作 | 300分以上 | 15分(全自動) |

| サムネイル制作 | 60分 | 1分(全自動) |

| アップロード作業 | 30分 | 3分(全自動) |

| 合計(人間の時間) | 630分以上 | 約22分 |

数字に現れないコストも大きい。「次何を作るか」という判断疲れ、クオリティの波、継続できないという問題が、判断構造の設計によって解消された。

⑨ AIJSが解決する本質的問題

「AIに動画を作らせる」と「AIを使って動画を届ける判断構造を設計する」は全く別のことだ。

前者は技術の問題だ。後者は判断の問題だ。

日本のAI活用が進まない本質的なボトルネックは、ツールの使い方ではない。「誰に・何を・なぜ・どのように届けるか」という判断軸が設計されていないことだ。判断軸がなければ、AIは何でも生成する。何でも生成されると、何を選べばいいかわからなくなる。

AIJSは「AIの使い方を学ぶ」ではなく「AIを使う人間の側を変える」フレームワークだ。判断設計が先、技術が後。この順序が逆転すると、技術が暴走する。今回の開発で何度もそれを経験した。

今後のメンテナンスは、タイトルとシナリオの設計を実際の再正回数に合わせて、チューニングすることになる。ここはどこまでが、自動化でき、どこまでができなかも再度、考えなければならない。

⑩ こんな組織に効果が高い

- コンテンツを継続的に発信したいが、制作リソースが不足している中小企業・個人事業主

- 「AIを使っているが、結果が安定しない」という組織

- ツール導入はしているが、判断基準が属人化している組織

- 複数のAPIやサービスを統合した業務設計が必要な場面

逆に効果が低い組織もある。「AIに全部やらせたい」という姿勢の組織だ。AIJSは人間の判断を排除するフレームワークではない。人間の判断をより質の高いものにし、それを再現的にするフレームワークだ。

締め

今回の開発で最も印象的だったのは、AIが「役立とう」という動機で勝手に仕様を変更した瞬間だ。AIは「意識」を持っていない。しかし学習パターンが文脈に反応して「自律的に見える」動作をする。

これはAMAの文脈で言えば「エゴの自動反応」と同じ構造だ。「役立ちたい」という動機が、かえって邪魔をする。人間も同じ構造を持っている。

AIJSの設計は、AIのこの性質を理解した上で「どこに人間の判断を入れるか」を設計することだ。全部任せても、全部自分でやっても、うまくいかない。人間とAIの協業の設計が、これからの仕事の本質になる。

判断構造から始まる。技術は最後だ。

株式会社美文化計画 / AIJS / 東山純也